El 13 de marzo, el Parlamento Europeo aprobó por una abrumadora mayoría la normativa sobre inteligencia artificial, con 523 votos a favor y solo 46 en contra. Según algunos medios, esta normativa entrará en vigor a mediados de 2026.

Con esta medida, la UE busca regular la inteligencia artificial para garantizar un desarrollo y uso más seguro y ético de esta tecnología innovadora. La regulación tiene como objetivo aprovechar los beneficios potenciales de la inteligencia artificial, como una mejor atención médica, un transporte más seguro y ecológico, una fabricación más eficiente y una energía más accesible y sostenible.

La prioridad del parlamento es garantizar que los sistemas de IA utilizados en la UE sean seguros, transparentes, trazables, no discriminatorios y respetuosos con el medio ambiente. Estos deben ser supervisados por personas, en lugar de por la automatización, para evitar resultados perjudiciales.

El Parlamento también quiere establecer una definición uniforme y tecnológicamente neutra de la IA que pueda aplicarse a futuros sistemas de IA.

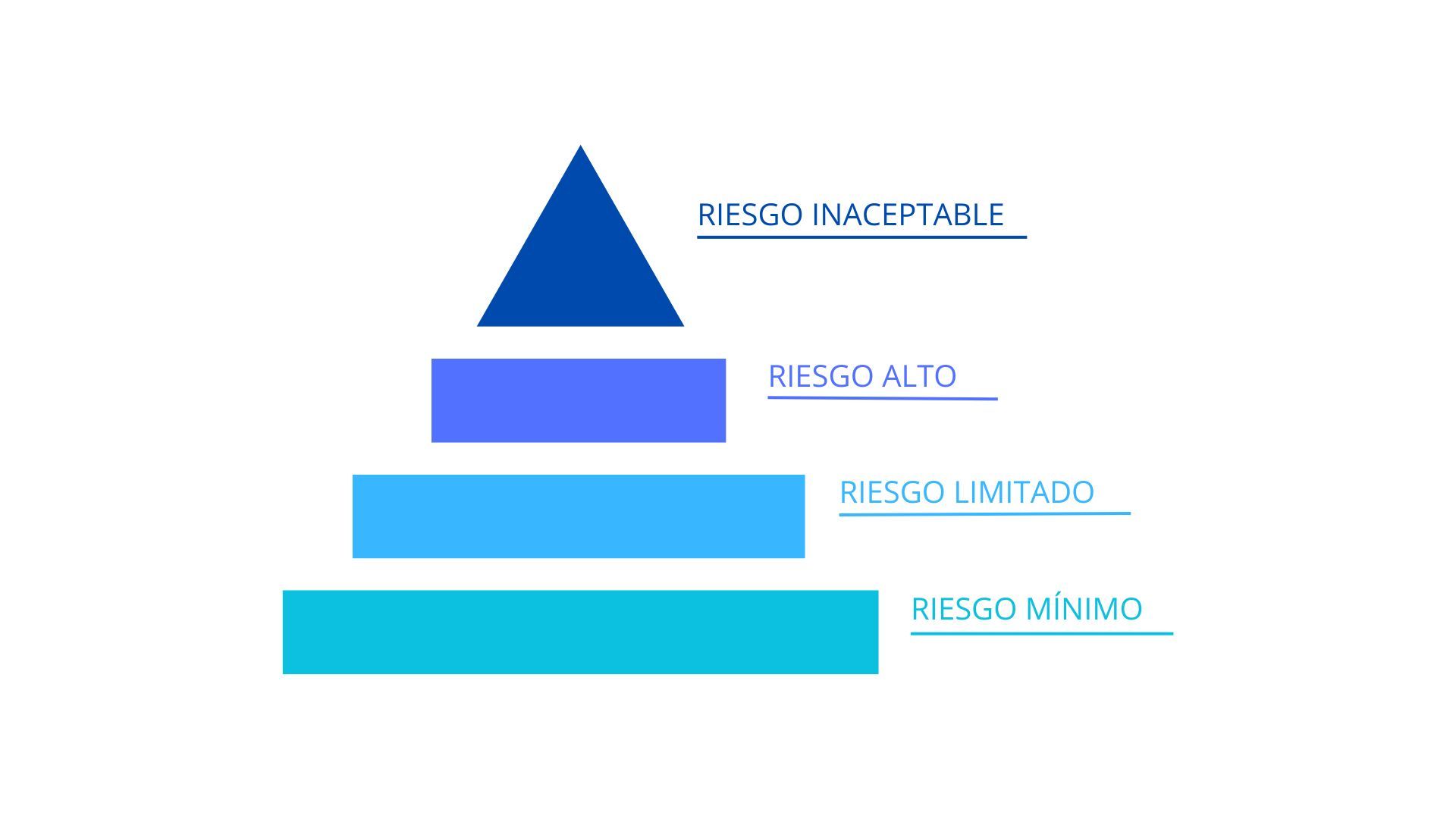

La nueva normativa establece obligaciones para proveedores y usuarios en función del nivel de riesgo de la IA. Aunque muchos sistemas de IA plantean un riesgo mínimo, es necesario evaluarlos todos.

Uno de los riesgos más importantes y que se consideran una amenaza para las personas es el riesgo inaceptable. Este incluye la manipulación cognitiva del comportamiento de personas o grupos vulnerables específicos, puntuación social y sistemas de identificación biométrica en tiempo real y a distancia.

También, el nivel de alto riesgo afecta negativamente a la seguridad o a los derechos fundamentales. Estos se dividen en dos categorías:

- Los sistemas de IA utilizados en productos sujetos a la legislación de seguridad de la UE, como juguetes, aviación, automóviles, dispositivos médicos y ascensores, estarán sujetos a regulaciones específicas para garantizar su seguridad y cumplimiento normativo.

- Los sistemas de IA pertenecientes a ocho ámbitos específicos deberán registrarse en una base de datos de la UE. Estos ámbitos incluyen la identificación biométrica, gestión de infraestructuras críticas, educación y formación profesional, empleo, acceso a servicios esenciales, aplicación de la ley, gestión migratoria y asistencia jurídica. Este registro busca garantizar la transparencia y el control sobre la aplicación de la IA en áreas sensibles.

La inteligencia artificial generativa, como ChatGPT, se considera de riesgo limitado, pero aún así debe cumplir con los requisitos de transparencia y con la legislación de la Unión Europea en materia de derechos de autor. Esto implica que, aunque su nivel de riesgo sea menor en comparación con otras formas de IA, sigue siendo necesario garantizar la transparencia en su funcionamiento y cumplir con las leyes de propiedad intelectual en la UE.

El texto definitivo de la legislación sobre inteligencia artificial (IA) se espera que sea aprobado en el pleno antes de que finalice la legislatura. Su plena aplicabilidad será 24 meses después de su entrada en vigor, pero algunas partes entrarán en vigor antes:

- La prohibición de sistemas de IA que planteen riesgos inaceptables se aplicará seis meses después de la entrada en vigor.

- Los códigos de buenas prácticas serán aplicables nueve meses después de la entrada en vigor.

- Las normas sobre sistemas de IA de uso general que deban cumplir requisitos de transparencia se aplicarán 12 meses después de la entrada en vigor.

- Los sistemas de alto riesgo tendrán un período de adaptación más largo, con obligaciones aplicables 36 meses después de la entrada en vigor.

Fuentes: Página Oficial de la Unión Europea y Telefónica